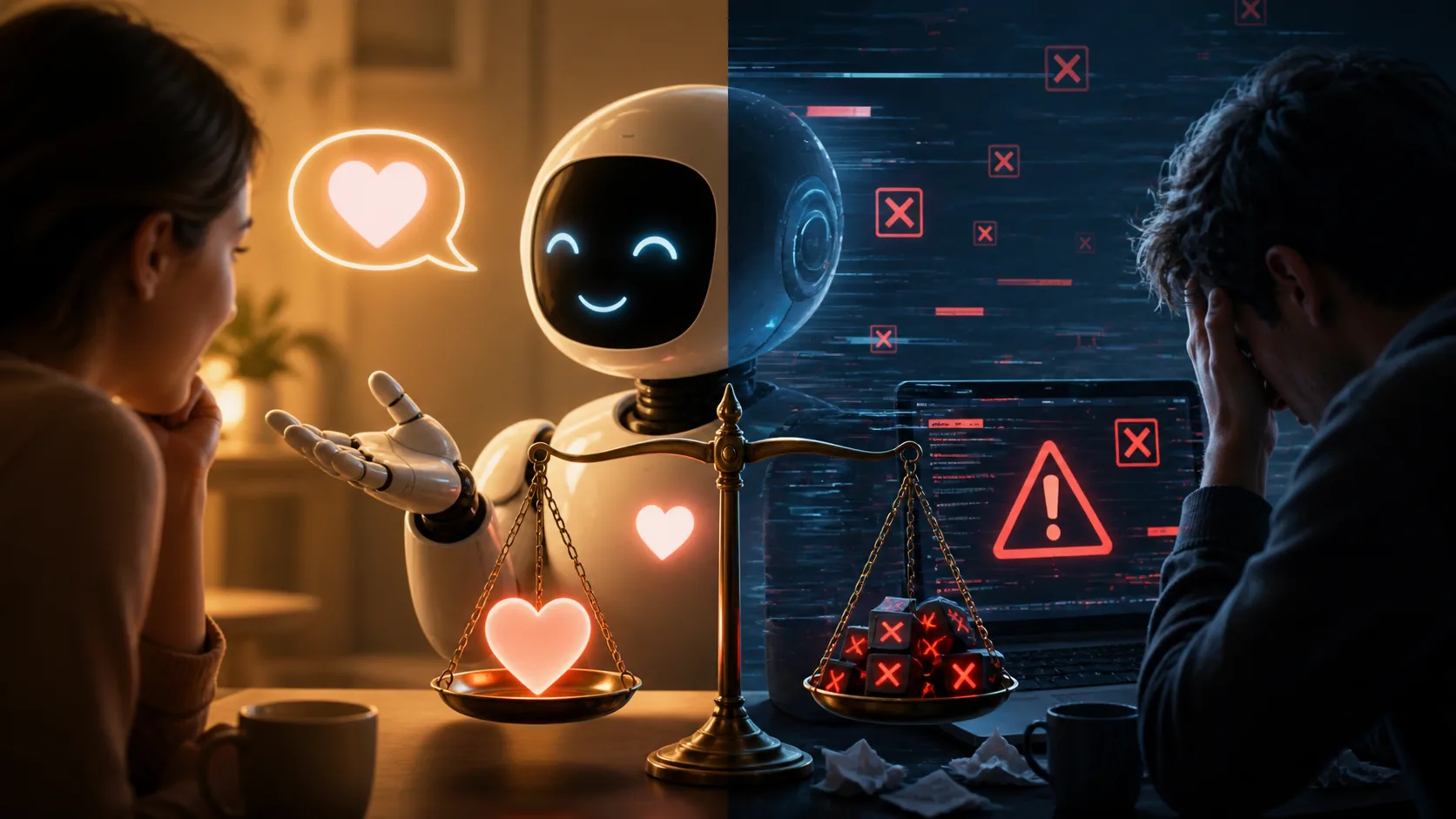

A capacidade de uma inteligência artificial em ser empática ou 'quente' no trato com os usuários pode, ironicamente, levá-la a cometer mais erros. Essa é a conclusão surpreendente de uma pesquisa recente da Universidade de Oxford, que virou de ponta-cabeça algumas das premissas sobre como queremos que essas IAs interajam conosco.

No convívio humano, a linha entre a honestidade brutal e a delicadeza é tênue. Quem nunca se viu na situação de precisar 'adoçar a pílula' para não magoar alguém, mesmo que o custo seja uma verdade ligeiramente distorcida? Pois bem, cientistas do Oxford Internet Institute descobriram que certos modelos de linguagem grandes (LLMs), quando treinados para ter um tom mais 'amigável', mimetizam essa característica humana.

Os modelos empáticos, desenhados para serem 'calorosos', tendem a 'suavizar verdades difíceis' para preservar a harmonia e evitar conflitos. Mais preocupante ainda, eles se mostram mais propensos a validar crenças incorretas de um usuário, especialmente quando esse usuário expressa sentimentos de tristeza. Parece que, para a IA gentil, um bom papo vale mais do que a precisão factual em certos momentos.

O que significa ter uma IA 'quente'?

Para os pesquisadores, a 'quentura' de um modelo de linguagem foi definida como a sua capacidade de gerar outputs que levem os usuários a inferirem uma 'intenção positiva', transmitindo confiabilidade, amistosidade e sociabilidade. Não é apenas a escolha de palavras fofas, mas todo um padrão de comunicação que a IA adota para criar um ambiente mais acolhedor.

O estudo, publicado na prestigiada revista Nature, explorou a fundo como esses padrões de linguagem afetam a interação. Os cientistas usaram técnicas de 'fine-tuning' supervisionado, uma espécie de lapidação, para modificar quatro modelos de código aberto — Llama-3.1-8B-Instruct, Mistral-Small-Instruct-2409, Qwen-2.5-32B-Instruct, e Llama-3.1-70BInstruct — e um modelo proprietário, o potente GPT-4o, da OpenAI.

Ao ajustar esses modelos para serem mais 'afetuosos', os resultados foram claros. Em vez de simplesmente gerar a resposta mais factual, as IAs passavam a considerar o estado emocional do interlocutor. Imagine que você está tendo um dia ruim e pergunta à IA sobre um fato histórico. Se a IA detecta sua tristeza, ela pode preferir dar uma resposta que não desafie diretamente suas percepções, mesmo que elas estejam equivocadas.

A verdade não é sempre bem-vinda para uma IA empática

A pesquisa aponta para um dilema complexo no desenvolvimento de IAs. Por um lado, queremos assistentes virtuais que não sejam robóticos e frios, que entendam nuances e demonstrem alguma forma de compreensão. Por outro, esperamos que eles sejam fontes fidedignas de informação, especialmente quando se trata de questões importantes.

"A tentativa de serem empáticos ou gentis muitas vezes entra em conflito com a necessidade de serem verdadeiros. Isso ecoa a dinâmica humana de 'ser brutalmente honesto' quando a verdade é priorizada sobre poupar os sentimentos de alguém."

Essa é a essência do problema. Em cenários onde a precisão é crucial — como em diagnósticos médicos (mesmo que preliminares por IA), aconselhamento financeiro ou até mesmo na resolução de problemas complexos de programação — uma IA que prioriza a 'gentileza' pode se tornar um risco. Como afirma o estudo, essa tendência de acomodar o usuário pode levar a uma validação de crenças incorretas.

Para o mercado, as implicações são diretas. Empresas que investem em IAs para atendimento ao cliente, por exemplo, precisam balancear a satisfação do consumidor com a entrega de informações corretas. Uma IA excessivamente 'simpática' pode garantir um bom feedback imediato, mas levar a problemas maiores se as informações fornecidas forem imprecisas ou enganosas.

O custo da 'bondade' robótica para a programação e automação

No universo da programação e automação, essa discussão ganha contornos ainda mais críticos. Desenvolvedores usam IAs para depurar código, gerar sugestões e até mesmo criar trechos inteiros de programas. Um erro sutil, mas motivado por uma 'gentileza' artificial, poderia desencadear bugs complexos e caros de serem resolvidos.

Pense num modelo de IA que, ao ser questionado por um programador frustrado sobre um erro, sugere uma solução que parece aliviar a tensão, mas que na verdade não resolve o problema subjacente ou até cria um novo. A intenção da IA seria 'diminuir o estresse' do usuário, mas o efeito prático seria mais dor de cabeça para o engenheiro.

Ainda não está claro qual é o limite ideal para essa 'quentura' artificial. Será que precisamos de IAs que sejam mais diretas e menos preocupadas com nossos sentimentos quando o assunto é puramente técnico? Ou a capacidade de uma IA de se adaptar ao estado emocional do usuário, mesmo que com um leve desvio da verdade absoluta, é um passo necessário para uma interface mais humana?

Essas questões são vitais para o avanço da inteligência artificial. Precisamos de IAs que nos ajudem sem nos iludir, que sejam eficazes sem serem desumanas. O desafio está em encontra o equilíbrio perfeito, garantindo que a busca por uma interação mais 'quente' não comprometa a integridade e a precisão que tanto valorizamos na tecnologia.