Em um cenário de crescente complexidade geopolítica e avanços tecnológicos, a desenvolvedora de Inteligência Artificial Anthropic, criadora do modelo Claude Mythos, está em negociações com a administração de Donald Trump. A notícia surge após o Pentágono ter rompido relações comerciais com a empresa, classificando-a como um risco à cadeia de suprimentos.

Essa interação demonstra a relevância estratégica da Inteligência Artificial (IA) no cenário global e a urgência em definir diretrizes para seu uso em áreas sensíveis como a defesa nacional. A disputa entre a Anthropic e o Pentágono destaca os desafios em conciliar inovação e segurança.

A polêmica com o Pentágono e o risco da cadeia de suprimentos

A controvérsia entre a Anthropic e o Pentágono teve início com divergências sobre as salvaguardas necessárias para o uso de ferramentas de IA pelos militares. Em um movimento sem precedentes, o Pentágono classificou a Anthropic como um risco da cadeia de suprimentos, resultando na proibição do uso de suas soluções pela agência e seus contratados.

Essa decisão ressalta a preocupação crescente com a segurança e a integridade dos sistemas de IA em contextos militares. A medida cautelar foi um revés para a empresa, que é uma das principais desenvolvedoras de IA de ponta.

“Temos uma disputa contratual restrita, mas não quero que isso atrapalhe o fato de que nos importamos profundamente com a segurança nacional”, afirmou o cofundador da Anthropic, Jack Clark, durante o evento Semafor World Economy em Washington, D.C.

A fala de Clark sublinha a intenção da empresa de manter um diálogo aberto com o governo dos Estados Unidos, apesar dos impasses recentes. A Anthropic reconhece a importância de suas tecnologias para a segurança nacional e busca colaborar para o estabelecimento de padrões.

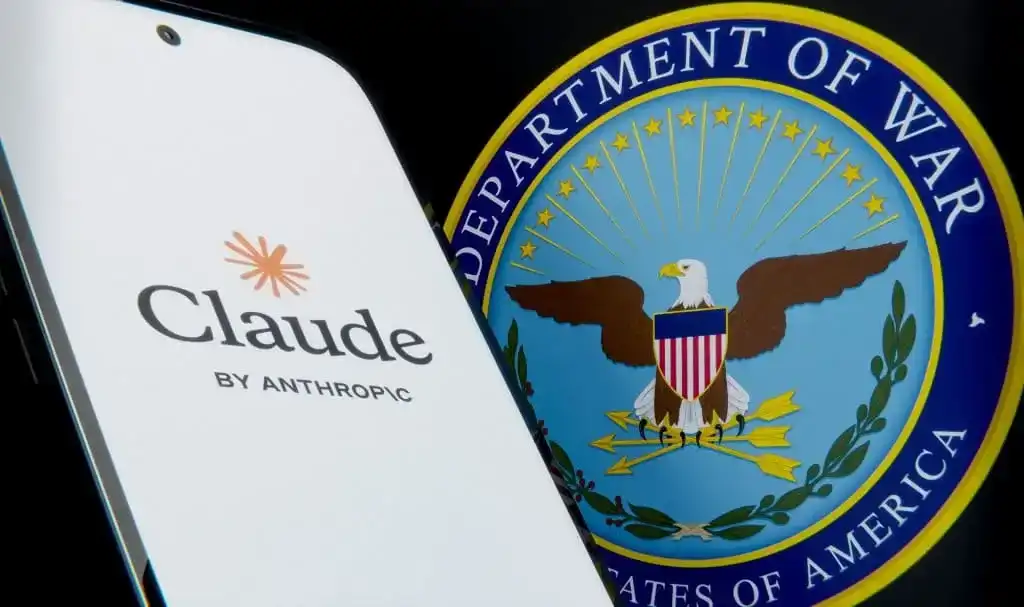

Pentágono declarou criadora do Claude como um risco à cadeia de suprimentos e à segurança nacional – Imagem: RixAiArt/Shutterstock

Claude Mythos: capacidades e implicações para a segurança cibernética

O Claude Mythos, anunciado em 7 de abril, representa um avanço significativo nos modelos de linguagem de grande escala. A Anthropic descreve-o como um modelo “ainda mais capaz” para codificação e tarefas agênticas. Esta última característica, a capacidade de o modelo atuar de forma autônoma, é particularmente relevante para o debate sobre segurança.

Especialistas consultados pela Reuters destacaram as capacidades do Mythos na codificação de alto nível. Esta habilidade poderia conferir ao modelo uma capacidade potencialmente grande para identificar vulnerabilidades em sistemas de segurança cibernética e, ao mesmo tempo, elaborar formas de explorá-las. Este é um ponto crucial que levanta preocupações em governos e instituições.

A promessa e o perigo de uma IA com tanta autonomia e capacidade de análise de código são evidentes. Enquanto pode ser uma ferramenta poderosa para fortalecer defesas cibernéticas, também representa um risco se cair nas mãos erradas ou se for mal utilizada.

A discussão sobre o Mythos com a administração Trump, e a intenção de discutir os próximos modelos, demonstra a complexidade da interação entre o setor privado da tecnologia e o setor público de defesa. Essas conversas são essenciais para moldar o futuro da segurança nacional na era da IA.

Reflexões sobre a regulação da IA e o papel do governo

A situação da Anthropic com o governo americano serve como um estudo de caso sobre a urgência na regulação da Inteligência Artificial. A ausência de um arcabouço legal claro para o desenvolvimento e uso de IAs avançadas gera incertezas e conflitos. A corrida tecnológica por modelos cada vez mais potentes pressiona os legisladores a agir.

A discussão sobre o Claude Mythos com líderes governamentais, como a administração Trump, reflete a percepção crescente de que a IA não é apenas uma tecnologia comercial, mas também uma questão de segurança nacional e soberania. O controle sobre essas tecnologias pode determinar o poder geopolítico futuro de uma nação.

A necessidade de um diálogo contínuo entre desenvolvedores, governos e a sociedade civil é fundamental. As capacidades do Mythos para identificar vulnerabilidades de segurança cibernética, por exemplo, mostram que a IA pode ter duas faces. Pode tanto proteger quanto comprometer sistemas críticos.

O caso Anthropic/Pentágono é um lembrete vívido desses desafios complexos.

Impacto global e perspectivas para o futuro

A controvérsia envolvendo a Anthropic e o governo dos Estados Unidos tem implicações que vão muito além das fronteiras americanas. Países ao redor do mundo, incluindo o Brasil, estão observando como essas discussões e decisões moldam o futuro da IA e da segurança nacional.

A classificação da Anthropic como um “risco da cadeia de suprimentos” pelo Pentágono pode influenciar outros governos a adotarem abordagens semelhantes na aquisição e uso de tecnologias de IA de empresas privadas. A preocupação com a origem e a confiabilidade de sistemas avançados será uma prioridade.

O desenvolvimento de modelos como o Claude Mythos, com suas capacidades de codificação e tarefas agênticas, levanta questões sobre o futuro da guerra cibernética e da segurança de infraestruturas críticas. A capacidade de uma IA de identificar e explorar falhas pode acelerar a dinâmica de ameaças e defesas.

A colaboração entre o setor privado e o governo, mesmo diante de tensões, é crucial para estabelecer um terreno comum e garantir que a IA seja desenvolvida e utilizada de forma ética e segura. A Anthropic, ao buscar diálogo com a administração Trump, sinaliza a disposição de participar ativamente dessa construção.

Em um mundo onde a Inteligência Artificial se infiltra em quase todos os setores, as decisões tomadas hoje sobre sua governança e regulamentação terão um impacto profundo nas próximas décadas.