Otimizando a Inferência de LLMs: Um Guia com TensorRT-LLM

No universo dinâmico da Inteligência Artificial, o desempenho da inferência é um fator crucial na implantação de Large Language Models (LLMs). Garantir que seus modelos operem com a máxima eficiência é essencial para qualquer aplicação, e é aqui que o ajuste fino se torna indispensável. O TensorRT-LLM, o motor de inferência de IA de código aberto da NVIDIA, emerge como uma ferramenta poderosa para desenvolvedores que buscam otimizar seus LLMs. Ele oferece recursos robustos para benchmarking e servindo modelos, permitindo um controle preciso sobre as métricas de desempenho.

Neste artigo exclusivo para a Vibe Coding Brasil, vamos mergulhar em um guia prático sobre como realizar o benchmarking de um modelo utilizando o trtllm-bench e, posteriormente, como prepará-lo para implantação com o trtllm-serve. Prepare-se para elevar o nível de suas aplicações de IA!

Como Realizar Benchmarking com trtllm-bench

A ferramenta chave para iniciar a otimização é o trtllm-bench, um utilitário Python do ecossistema TensorRT-LLM. Ele foi projetado para comparar modelos de forma direta e eficiente, eliminando a complexidade de uma implantação de inferência completa. Isso permite que os desenvolvedores obtenham insights rápidos e precisos sobre o desempenho do modelo, pois o trtllm-bench configura o motor internamente com parâmetros que visam a performance ideal.

Configurando o Ambiente da GPU

Para garantir resultados precisos e otimizados, o ponto de partida é um ambiente de GPU devidamente configurado. Siga estes passos para ajustar suas GPUs:

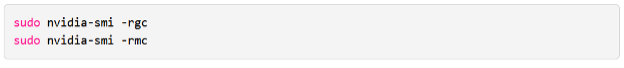

Restaurar configurações padrão: Para reverter suas GPUs às configurações originais, execute:

Consultar uso máximo: Para verificar o limite de uso de potência da sua GPU:

Definir limite de potência: Caso deseje especificar um limite de potência, ou definir o máximo permitido:

Para informações mais aprofundadas sobre o gerenciamento do clock da GPU, consulte a documentação oficial do trtllm-bench.

Preparando o Conjunto de Dados para Testes

Para um benchmarking eficaz, é fundamental ter um conjunto de dados adequado. Você pode optar por:

Gerar um conjunto de dados sintético utilizando o utilitário

prepare_dataset.Criar seu próprio conjunto de dados, seguindo o formato detalhado na documentação.

Caso escolha um conjunto de dados personalizado, ele deve ser formatado como um arquivo JSON Lines (.jsonl), onde cada linha contém uma carga configurada. Abaixo, um exemplo de uma única entrada de dados:

Para os exemplos desta publicação, utilizaremos uma saída baseada em um conjunto de dados sintético com um Input Sequence Length (ISL) e Output Sequence Length (OSL) de 128/128, que oferece um cenário balanceado para avaliação.

Executando os Benchmarks de Desempenho

Com o ambiente configurado e o conjunto de dados pronto, é hora de rodar os benchmarks. Utilize o subcomando throughput do trtllm-bench para este propósito.

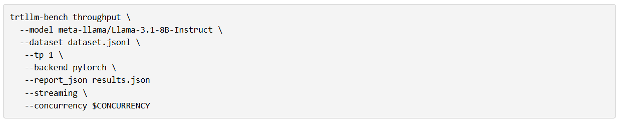

Para executar um benchmark usando o fluxo do PyTorch, garantindo que o TensorRT-LLM esteja instalado em seu ambiente, o comando é simples e direto:

Este comando automatiza várias etapas cruciais:

Ele extrairá automaticamente o checkpoint do HuggingFace (caso não esteja em cache localmente).

Inicializará o TensorRT-LLM com o fluxo de trabalho do PyTorch.

Após a conclusão da execução, os resultados detalhados serão salvos em um arquivo results.json e também exibidos diretamente no terminal. É uma forma clara e concisa de visualizar o desempenho.

Detalhes Técnicos: A saída exibida no terminal é uma amostra e serve para ilustrar a estrutura dos resultados. É importante notar que estes não são dados de desempenho definitivos e devem ser interpretados como um exemplo.