Em 1928, Londres enfrentava uma severa crise de saúde pública, devastada por doenças bacterianas como pneumonia, tuberculose e meningite. Confinados em laboratórios estéreis, cientistas e médicos estavam presos em um ciclo incessante de tentativa e erro, utilizando abordagens médicas tradicionais para resolver problemas complexos. Foi então que, em setembro de 1928, um evento acidental mudou o curso da história: o Dr. Alexander Fleming, um médico escocês, esqueceu de fechar uma placa de Petri, que acabou sendo contaminada por mofo. Fleming notou algo peculiar: todas as bactérias próximas à umidade haviam morrido, enquanto as outras sobreviveram. Essa observação levou à descoberta da Penicilina, um potente antibiótico que revolucionou a medicina.

A história dos carros autônomos pode estar seguindo um caminho semelhante. Na década de 2010, a maioria desses veículos foi construída utilizando uma abordagem que chamamos de “modular”. O software autônomo era dividido em vários módulos, como Percepção (a tarefa de interpretar o mundo), Localização (a tarefa de se posicionar precisamente no mundo) e Planejamento (a tarefa de criar uma trajetória para o carro seguir, agindo como o “cérebro” do veículo). Por fim, todos esses módulos confluíam para o último: Controle, que gerava comandos como “esterçar 20° para a direita”. Essa era a abordagem bem estabelecida.

No entanto, uma década depois, as empresas começaram a levar a sério outra disciplina: o Aprendizado End-to-End. A ideia central é substituir cada módulo por uma única rede neural que prevê a direção e a aceleração, mas, como se pode imaginar, isso introduz o problema da “caixa preta”.

Os 4 Pilares dos Carros Autônomos: Percepção, Localização, Planejamento e Controle. Poderia um Large Language Model replicá-los? (fonte)

Embora essas abordagens sejam conhecidas, elas ainda não resolveram completamente o problema da direção autônoma. Assim, nos questionamos: “E se os LLMs (Large Language Models), que atualmente estão revolucionando o mundo, fossem a resposta inesperada para a direção autônoma?”

É o que vamos explorar neste artigo, começando com uma explicação simples do que são os LLMs e, em seguida, mergulhando em como eles poderiam beneficiar a direção autônoma. Para mais insights sobre o uso de IA em sistemas complexos, veja nosso artigo sobre Drones Submarinos: A Batalha pela Autonomia Marítima, que explora a autonomia em outro ambiente desafiador.

A Evolução da Direção Autônoma: Do Modular ao End-to-End

A jornada rumo aos carros autônomos tem sido marcada por uma constante busca por abordagens mais eficazes. Inicialmente, o foco estava na compartimentalização, onde cada aspecto da condução autônoma era tratado por um módulo especializado.

Detalhes Técnicos: O sistema modular divide o processo de condução em etapas discretas: a Percepção identifica objetos e condições da via; a Localização determina a posição exata do veículo; o Planejamento traça a rota e as manobras; e o Controle executa as ações físicas do veículo. Essa arquitetura permite um desenvolvimento e depuração mais organizados, mas a integração perfeita de todos os módulos e a gestão de exceções complexas permanecem como desafios significativos.

A transição para o aprendizado End-to-End representa uma mudança de paradigma, visando uma solução mais integrada. No entanto, a complexidade inerente e a dificuldade de interpretar as decisões tomadas por uma única rede neural – a famosa “caixa preta” – ainda são barreiras a serem superadas. Para desenvolvedores interessados em otimizar seus workflows com ferramentas de IA, nosso guia sobre Claude AI: 5 Funções Essenciais para Devs e Automação oferece dicas valiosas.

LLMs: A Peça que Faltava na Autonomia?

A ascensão dos Large Language Models (LLMs) tem sido meteórica, transformando diversas indústrias com sua capacidade de processar e gerar linguagem humana de forma sofisticada. O Vibe Coding Brasil acompanha de perto esses desenvolvimentos, inclusive as vulnerabilidades de segurança em LLMs, mostrando a importância de uma implementação robusta.

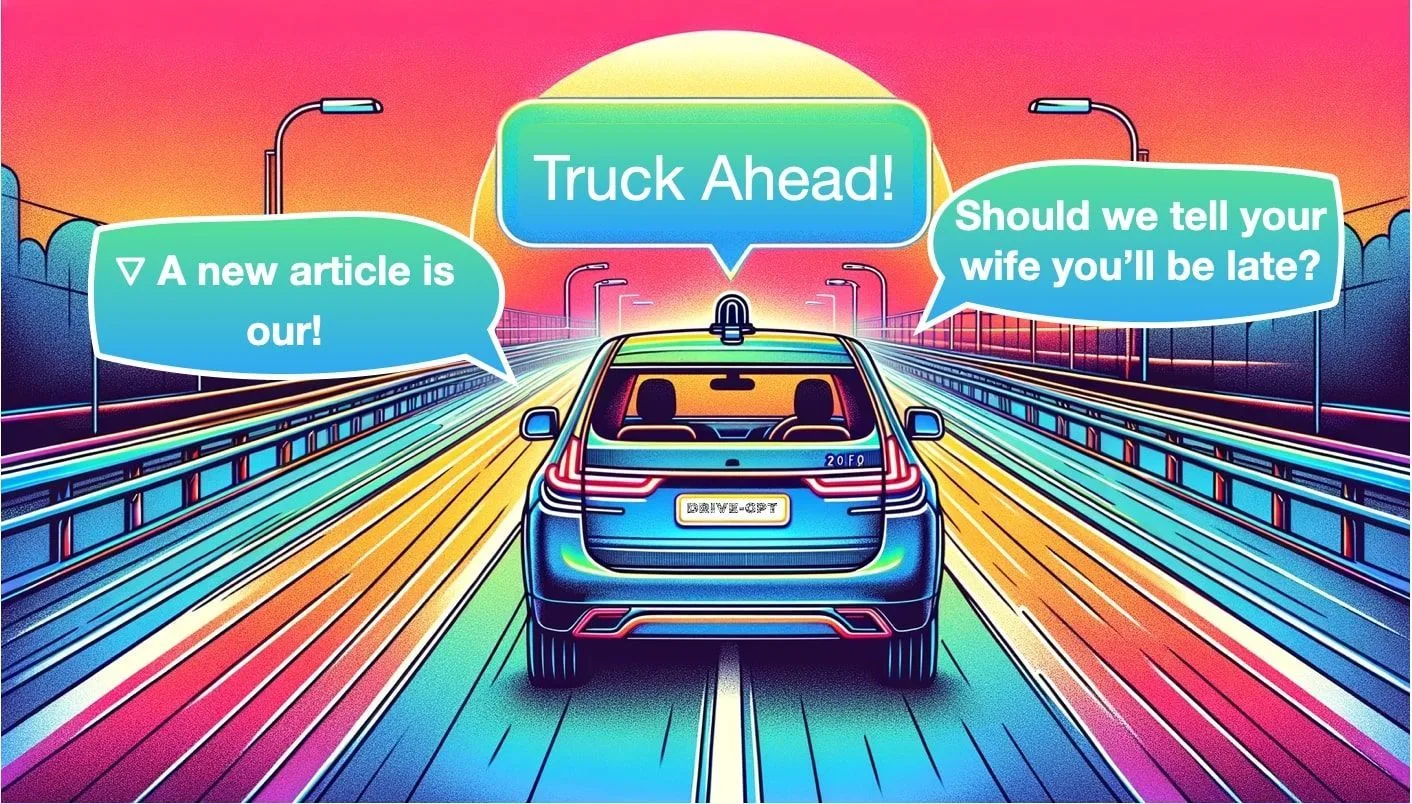

No contexto da direção autônoma, a aplicação de LLMs pode parecer, à primeira vista, um salto audacioso. No entanto, a capacidade desses modelos de compreender contextos complexos, inferir intenções e tomar decisões baseadas em grandes volumes de dados pode ser exatamente o que falta para unificar os módulos de Percepção, Localização, Planejamento e Controle em um sistema mais coeso e adaptável.

Entendendo os Fundamentos dos LLMs

Para aqueles que ainda estão se familiarizando com os LLMs, o conceito pode parecer intimidador. Mas, para simplificar, podemos dividi-los em três ideias chave:

Tokenização: Em um LLM como o ChatGPT, o texto de entrada é primeiro convertido em “tokens”. Um token pode ser uma palavra, um caractere ou qualquer unidade definida. Essencialmente, é a forma como o modelo “quebra” a linguagem para processá-la, transformando palavras em representações numéricas que a rede neural pode entender.

Exemplo de tokenização de uma frase, onde cada palavra se torna um "token"