Considerado um tema quase proibido na comunidade de Inteligência Artificial, o conceito de consciência em IA agora ocupa o centro das discussões. Essa mudança é notável desde o ressurgimento da IA, há mais de uma década. Um exemplo marcante foi Blake Lemoine, engenheiro do Google, que no ano passado ganhou as manchetes ao afirmar que o grande modelo de linguagem que ele estava desenvolvendo havia se tornado senciente. CEOs de empresas de tecnologia são agora questionados abertamente em entrevistas sobre a possibilidade de seus sistemas de IA um dia desenvolverem consciência.

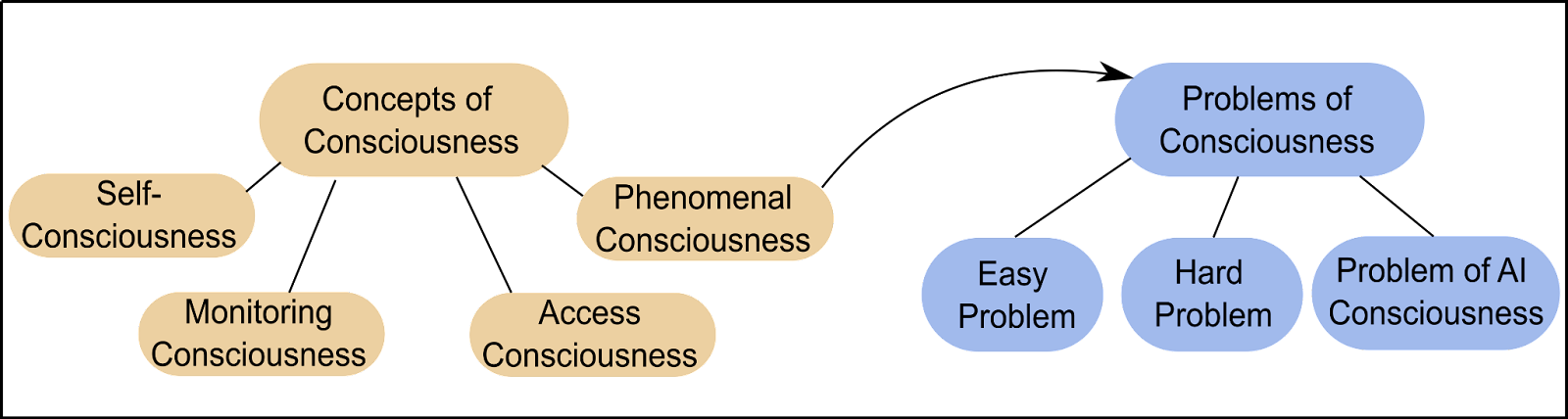

Infelizmente, grande parte da discussão pública carece de uma compreensão clara dos trabalhos anteriores sobre o tema. Em entrevistas, engenheiros, pesquisadores de IA e executivos de tecnologia frequentemente definem a consciência de maneiras implícitas e distintas, sem uma percepção clara das dificuldades filosóficas que envolvem a consciência, ou sua relevância para o debate da consciência em IA. Outros têm dificuldade em entender por que a possibilidade da consciência artificial é interessante em comparação com outros problemas, como a questão do alinhamento da IA.

Esta breve introdução é destinada àqueles que trabalham na comunidade de IA e estão interessados na consciência artificial, mas podem não ter muito conhecimento sobre o trabalho filosófico e científico por trás da consciência em geral, ou sobre a consciência da IA em particular. O objetivo aqui é destacar as definições e ideias-chave da filosofia e da ciência relevantes para os debates sobre a consciência em IA de forma concisa e com o mínimo de jargão.

Por Que Se Preocupar com a Consciência em IA?

Primeiramente, por que deveríamos nos preocupar com o desenvolvimento prospectivo de uma IA consciente? A razão mais importante para tentar entender as questões em torno da consciência em IA é o fato de que o status moral da IA (ou seja, os direitos morais que a IA pode ou não ter) depende crucialmente dos tipos de estados conscientes que a IA é capaz de possuir. Filósofos morais divergem nos detalhes, mas geralmente concordam que a consciência de um agente (ou sua ausência) desempenha um papel importante na determinação dos direitos morais que esse agente possui.

Por exemplo, uma IA incapaz de sentir dor, emoção ou qualquer outra experiência, provavelmente carece da maioria ou de todos os direitos que os humanos desfrutam, mesmo que seja altamente inteligente. Uma IA capaz de experiências emocionais complexas, provavelmente compartilha muitos deles. Se nos preocupamos em tratar moralmente outras criaturas inteligentes, como a IA, então aqueles que constroem e interagem com a IA deveriam se importar profundamente com a filosofia e a ciência da consciência. Essa discussão também se alinha com as preocupações levantadas em artigos como "A Babá Digital: IA Companheira de Crianças e Seus Riscos", que aborda os dilemas éticos dos companheiros de IA.

Infelizmente, há pouco consenso sobre os fatos básicos da natureza da consciência, por razões discutidas abaixo. Isso implica que há pouco consenso sobre o status moral da IA atual e, o que é mais preocupante, da IA avançada que parece estar no horizonte próximo. Podemos enquadrar essa preocupação geral da seguinte forma:

O Problema do Status Moral da IA: Cientistas e filósofos atualmente carecem de consenso/confiança sobre fatos básicos relativos à natureza da consciência. O status moral da IA depende crucialmente desses fatos. A IA está avançando rapidamente, mas o progresso na compreensão da consciência é lento. Portanto, podemos em breve enfrentar um cenário em que temos a capacidade de construir IA altamente inteligente, mas carecemos da capacidade de identificar com confiança o status moral de tal IA.

Alguns filósofos argumentaram que, sem abordar diretamente esse problema, corremos o risco de uma espécie de catástrofe moral, onde atribuímos direitos massivamente errados à IA (ou seja, super ou subestimamos direitos em grande escala). Tais atribuições errôneas de direitos poderiam ter consequências prejudiciais: se superestimarmos os direitos, acabaremos tirando recursos importantes de agentes morais (ou seja, humanos) e dando-os a IAs que não possuem status moral significativo. Se subestimarmos os direitos da IA, poderemos acabar maltratando um grande número de agentes morais de várias maneiras.

Essa complexidade ética ressalta a importância de debater as implicações sociais e políticas da IA, conforme visto em discussões sobre desinformação em "YouTube: Desinformação Política Gerada por IA Atinge 1.2 Bi de Views", onde a responsabilidade pelo uso da tecnologia é central. Alguns filósofos sugeriram que devemos implementar proibições na construção de qualquer coisa com um status moral questionável. Alguns cientistas argumentaram que precisamos investir mais recursos na compreensão da consciência.

Em todo caso, o progresso nesta questão exige que pesquisadores em filosofia, neurociência e IA tenham uma compreensão compartilhada das definições fundamentais, problemas e possíveis caminhos a seguir sobre o tema da consciência em IA. O restante desta introdução é dedicado a apresentar trabalhos que estabelecem esses fundamentos.