A linha entre confidente e delator nunca esteve tão tênue no mundo digital, especialmente quando se trata de inteligência artificial. Se você pensava que suas conversas com chatbots eram privadas, a saga legal entre Elon Musk e a OpenAI serve como um balde de água fria cibernético. No olho do furacão, está uma figura central da empresa, cujo diário pessoal agora expõe segredos não apenas de sua própria vida, mas dos bastidores de uma das startups mais valiosas do planeta.

A cena, digna de um roteiro de Hollywood, se desenrola nos tribunais, onde Greg Brockman, presidente e cofundador da OpenAI, se vê obrigado a ler trechos íntimos de suas anotações, incluindo aquelas sobre o próprio Elon Musk. É um lembrete vívido de que a era da IA, apesar de suas promessas de conveniência e personalização, traz consigo uma vigilância sem precedentes, onde o que é dito a um algoritmo pode, eventualmente, tornar-se prova em um tribunal ou manchete em um jornal.

Antes que você peça ao ChatGPT para organizar a bagunça, vamos ao cerne da questão. Elon Musk está travando uma batalha legal acirrada contra Brockman e Sam Altman, o CEO da OpenAI. Musk, que já foi membro do conselho da empresa, acusa os executivos de violarem o acordo fundador da startup ao transformá-la em uma entidade com fins lucrativos. A contra-argumentação de Altman e companhia é que Musk estaria simplesmente frustrado por não ter mais controle sobre a empresa e, por isso, tenta derrubar um concorrente de peso.

O drama se aprofunda quando o foco recai sobre o infame diário de Brockman. De acordo com o jornal The Guardian, esta peça de evidência inesperada tem sido um dos pontos altos do processo. “Brockman tem sido interrogado sobre anotações de diário que fez em 2018 sobre a ‘mentalidade’ de Musk – incluindo sugestões de que Musk estava propenso a ‘mentiras diretas’ e era ‘bastante tóxico’ – e como ele pode ter ‘dramatizado demais’ sua própria importância”, relata a publicação, destacando o teor explosivo das revelações. A transparência na AI, ironicamente, expõe a falta de privacidade de seus próprios criadores.

A relevância deste caso vai muito além dos bilionários em guerra. Ele joga luz sobre uma questão fundamental para todos nós que interagimos diariamente com assistentes virtuais, chatbots de serviço ao cliente ou até mesmo ferramentas de IA generativa. Se os registros mais pessoais de um dos criadores da inteligência artificial podem se tornar públicos, o que dizer de nossas próprias conversas, que muitas vezes contêm informações sensíveis sobre saúde, finanças, planos de negócios ou até mesmo fofocas triviais?

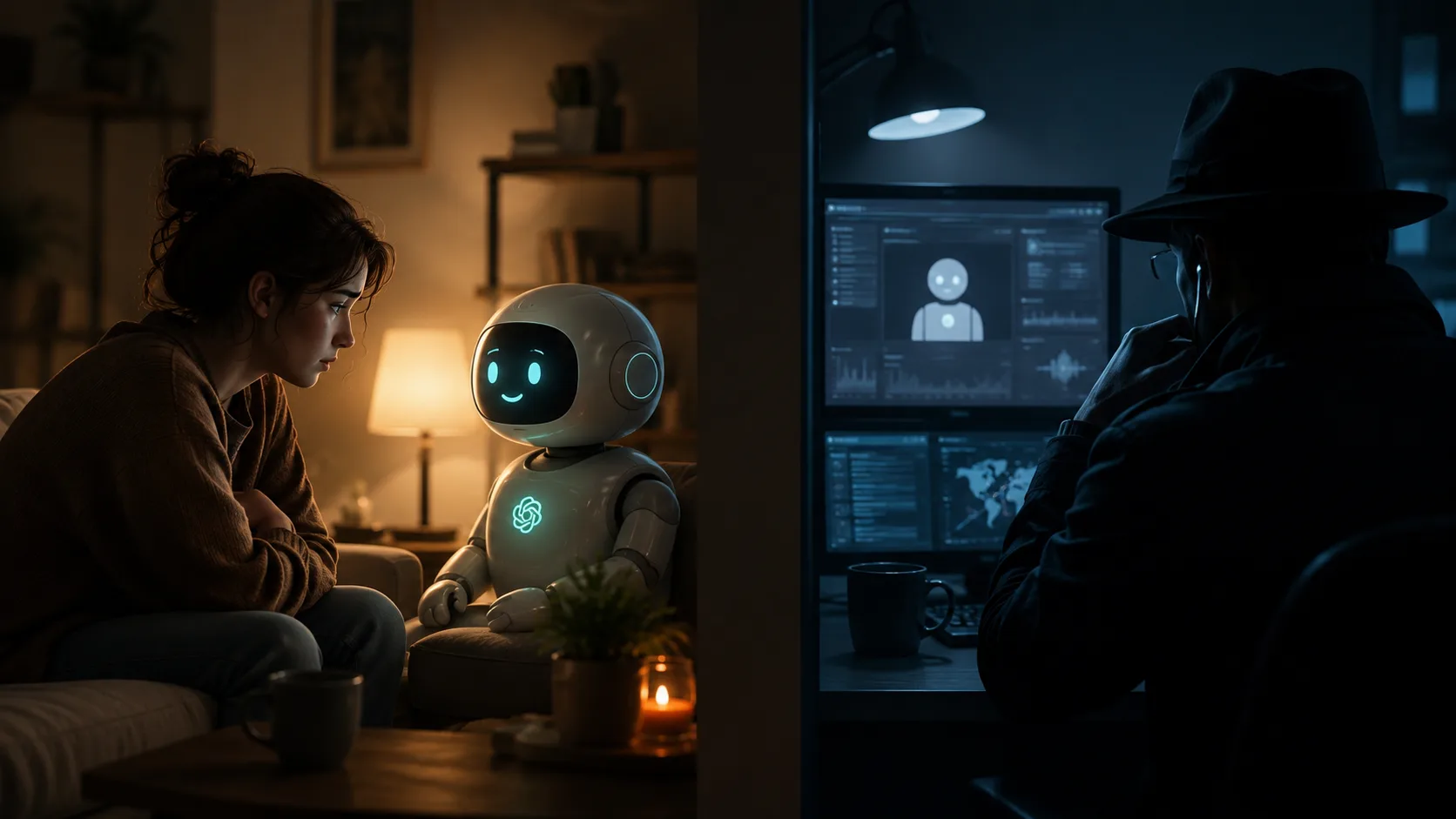

Chatbots: Confidentes ou Detetives Digitais?

Por muito tempo, a ideia de compartilhar informações com uma máquina era vista como algo inofensivo, talvez até catártico. As pessoas desabafam, buscam conselhos e, em alguns casos, usam chatbots como uma espécie de diário digital interativo. Contudo, a controvérsia da OpenAI reacende o debate sobre a real natureza da privacidade nesses sistemas.

A verdade é que qualquer dado que você insere em um sistema de IA não está, por definição, apagado, nem inerentemente privado. Ele é armazenado, processado e, em muitos casos, utilizado para treinar e aprimorar o próprio modelo de IA. Empresas criam termos de serviço que pouca gente lê e, em letras miúdas, há frequentemente cláusulas que permitem o uso desses dados para fins internos, pesquisa ou até mesmo em conformidade com ordens judiciais. O diário de Brockman é a prova cabal de que aquilo que você pensa ser uma anotação íntima pode, sob escrutínio legal, virar material de acusação.

A Business Insider, acompanhando o julgamento, chegou a transmitir trechos das audiências, mostrando o impacto público de tal exposição. A ideia de que um diário, mesmo que inicialmente um espaço de reflexão pessoal, um dia seria lido em voz alta em um tribunal, é um pesadelo da privacidade materializado. Isso não apenas serve como um alerta para os executivos de tecnologia, mas para qualquer pessoa que use plataformas digitais.

“É um lembrete aterrorizante de que o que é divulgado à IA realmente não é privado,”

concluiu o artigo original do The Guardian, resumindo bem a gravidade da situação. A citação, concisa e direta, ressoa com uma verdade incômoda para a era digital.

No Brasil, onde a Lei Geral de Proteção de Dados (LGPD) tenta impor limites rigorosos ao tratamento de dados pessoais, o caso OpenAI serve como um estudo de caso valioso. Embora a LGPD foque mais na proteção de dados de usuários finais, a exposição de informações pessoais de um executivo de tecnologia em um contexto jurídico demonstra que a privacidade é um território frágil para todos. Para as empresas que desenvolvem e utilizam IA no país, a lição é clara: a governança de dados precisa ir muito além das obrigações legais básicas e englobar uma cultura de privacidade robusta, refletindo não apenas a lei, mas a ética e a confiança do usuário.

Este embate entre Musk e a OpenAI não é apenas sobre o destino de uma empresa de bilhões de dólares, mas sobre a própria natureza da confiança na tecnologia. À medida que os chatbots se tornam mais sofisticados e onipresentes, a tentação de tratá-los como confidentes tecnológicos cresce. No entanto, o caso Brockman nos obriga a reavaliar essa premissa. Eles são ferramentas poderosas, com capacidade de processamento de linguagem natural que imita a interação humana, mas não são dotados de discrição ou de sigilo profissional.

A ironia é que a mesma tecnologia que nos promete um futuro de eficiência e conveniência é a que agora nos mostra a vulnerabilidade de nossa privacidade quando nos expomos a ela. O diário de um executivo é apenas o começo. Quantas outras conversas, trocas de ideias e desabafos silenciosos com algoritmos estão à espera de um “vazamento” ou de uma intimação judicial para virem à tona? A era da IA pode estar apenas começando, mas a era da privacidade absoluta, para muitos, já pode ter chegado ao fim. O que nos resta é uma reflexão: que tipo de confidências estamos dispostos a entregar a uma entidade que não é um terapeuta, mas pode, por design ou por imposição legal, se tornar um dedo-duro?