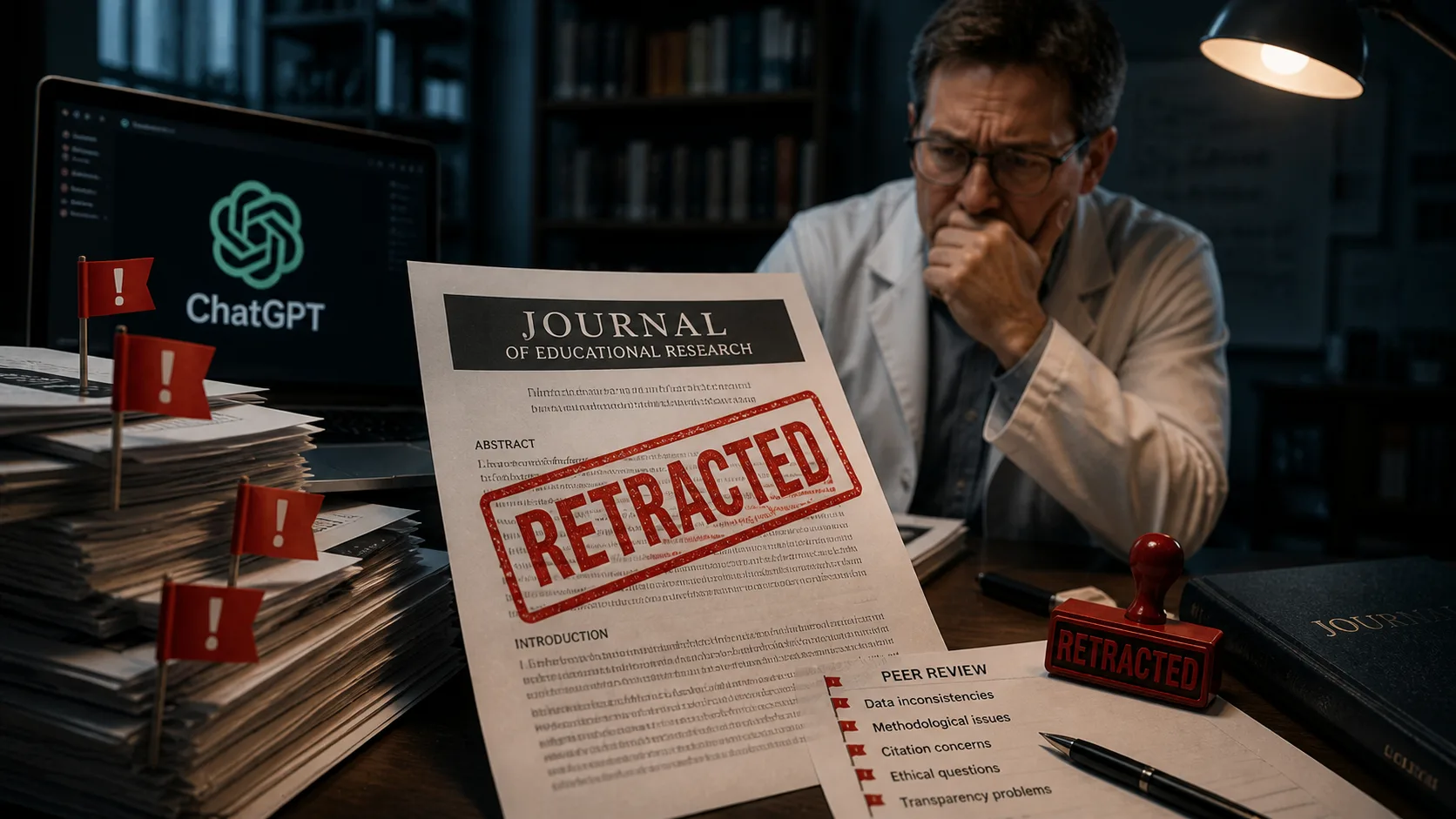

A bolha que envolvia os benefícios do ChatGPT na educação parece ter estourado para um estudo, até então, influente. Uma pesquisa que alegava impactos positivos da ferramenta da OpenAI no aprendizado de estudantes foi simplesmente retirada de uma revista científica. Isso aconteceu quase um ano após sua publicação original. A editora do periódico, a prestigiada Springer Nature, citou “discrepâncias” na análise e uma perda de confiança nas conclusões. O detalhe é que isso não impediu que o artigo acumulasse centenas de citações e circulasse amplamente pelas redes sociais.

A controvérsia acende um alerta sobre a necessidade de rigor na pesquisa sobre inteligência artificial, especialmente em áreas sensíveis como a educação. À medida que o uso de ferramentas como o ChatGPT se populariza, a validação científica de seus efeitos torna-se ainda mais crucial. A retirada do estudo não apenas questiona as conclusões, mas também a forma como a pesquisa foi inicialmente revisada e aceita.

Os autores do artigo fizeram algumas alegações muito chamativas sobre os benefícios do ChatGPT nos resultados de aprendizagem.

A afirmação acima é de Ben Williamson, professor sênior do Centro de Pesquisa em Educação Digital e do Instituto Edinburgh Futures na Universidade de Edimburgo, na Escócia. Ele compartilhou essa percepção em um email, adicionando que o estudo “foi tratado por muitos nas redes sociais como uma das primeiras evidências concretas e de alto padrão de que o ChatGPT, e a IA generativa de forma mais ampla, beneficia os alunos”. Essa percepção inicial, entretanto, contradiz a subsequente retirada do artigo, evidenciando a dualidade entre a expectativa pública e a comprovação científica.

A metodologia sob o escrutínio científico

O artigo que agora foi retirado tentou quantificar “o efeito do ChatGPT no desempenho de aprendizagem dos alunos, na percepção da aprendizagem e no pensamento de ordem superior”. Para isso, analisou resultados de 51 estudos de pesquisa anteriores. A meta-análise calculou o tamanho do efeito entre os grupos experimentais que usaram o ChatGPT na educação e os grupos de controle que não utilizaram o chatbot de IA. A ideia era criar um panorama robusto, mas a execução e a interpretação dos dados falharam no crivo da reavaliação.

Um dos pontos levantados pela Springer Nature, inclusive, é que a análise apresentava problemas metodológicos importantes. A escolha dos estudos incluídos, a forma como os dados foram agregados e até mesmo a interpretação estatística do “tamanho do efeito” parecem ter sido questionadas. Erros desse tipo podem levar a conclusões enganosas, que, neste caso, foram detectados e corrigidos, ainda que tardiamente. A repercussão do estudo, antes de sua retirada, exemplifica bem como a necessidade de provas baseadas em evidências pode ser suplantada pelo entusiasmo em torno de uma tecnologia emergente.

Impacto da retratação no debate sobre a IA na educação

A retirada de um estudo de uma revista científica não é um evento inédito, mas quando se trata de um tópico tão efervescente quanto a inteligência artificial na educação, as implicações são vastas. Para educadores e formuladores de políticas, a decisão da Springer Nature serve como um lembrete crucial: é preciso cautela. A euforia em torno das novas tecnologias, por vezes, ignora a importância de uma validação rigorosa e transparente.

O episódio também ressalta a pressão que os pesquisadores enfrentam para publicar resultados que possam ser considerados “inovadores” ou “revolucionários”. Às vezes, essa pressão pode comprometer a adesão a métodos de pesquisa sólidos e imparciais. A ética na publicação científica exige que os achados sejam verificáveis e que as conclusões sejam apoiadas por dados robustos, algo que, aparentemente, faltou neste caso específico.

Além disso, a confusão gerada pela retratação pode minar a confiança do público e dos profissionais da educação na pesquisa acadêmica sobre IA. Se um estudo amplamente divulgado e citado se revela falho, surgem questionamentos sobre a validade de outras pesquisas na área. Isso exige um esforço redobrado por parte da comunidade científica para assegurar a qualidade e a integridade de seus trabalhos futuros.

O futuro da IA na educação: Caminhos e desafios

Mesmo com a nuvem de incerteza pairando sobre estudos como o mencionado, a inteligência artificial continua a ser uma ferramenta promissora para o setor educacional. O incidente não descarta o potencial do ChatGPT ou de outras IAs generativas, mas reforça a necessidade de abordagens mais críticas e bem fundamentadas. Em vez de simplesmente elogiarem ou demonizarem a tecnologia, pesquisadores e educadores devem focar em como ela pode ser implementada de forma eficaz, ética e equitativa.

Existe um campo vasto para explorar: a personalização do aprendizado, o apoio a alunos com necessidades especiais, a automação de tarefas administrativas e a criação de materiais didáticos inovadores. No entanto, cada uma dessas aplicações deve ser submetida a análises rigorosas, com estudos bem desenhados e capazes de fornecer evidências irrefutáveis. O Brasil, onde a discussão sobre o uso de IA nas escolas ainda está no início, pode aprender com o que aconteceu lá fora.

Precisamos de estudos que enderecem questões como a parcialidade dos algoritmos, a proteção de dados dos estudantes e o impacto das ferramentas de IA na criatividade e no pensamento crítico. A comunidade de Vibe Coding tem muito a contribuir com essas discussões, desenvolvendo ferramentas e metodologias que garantam um uso responsável e realmente benéfico da IA no ambiente educacional. Será que a comunidade acadêmica vai levar mais a sério o escrutínio de pesquisas que tocam em pontos tão importantes para o futuro do aprendizado?