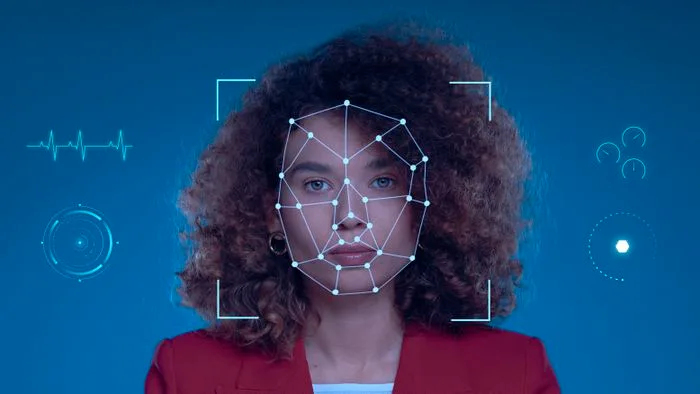

A biometria, seja por impressões digitais, reconhecimento facial ou voz, tornou-se o método preferido de autenticação para grande parte dos brasileiros, com 73% já optando por essa tecnologia para acessar seus dispositivos e contas pessoais, conforme pesquisa da Accenture. Essa preferência reflete a praticidade e a percepção de segurança que esses métodos oferecem. No entanto, mesmo com todo o avanço, a era digital traz consigo novos desafios: golpistas estão cada vez mais sofisticados, utilizando deepfakes e outras técnicas avançadas para burlar esses sistemas de segurança.

A Juniper Research aponta que mais de 4,2 bilhões de dispositivos móveis já empregam biometria ativa, e a previsão é que, até o final de 2026, 57% de todas as transações digitais globalmente sejam validadas por esses métodos. Essa expansão massiva, embora positiva para a agilidade, também atrai a atenção de cibercriminosos, que desenvolvem novas técnicas de ataque em um ritmo alarmante.

A Ascensão dos Deepfakes e a Vulnerabilidade Biométrica

Anchises Moraes, Head de Threat Intelligence na Apura Cyber Intelligence, destaca que, embora as tecnologias biométricas reforcem a segurança governamental e privada, elas também fornecem ferramentas potentes aos cibercriminosos, especialmente através do mau uso da Inteligência Artificial. As estratégias dos fraudadores variam desde simples fotos digitais de alta resolução e vídeos em HD até a criação de máscaras de silicone ultrarrealistas e softwares de manipulação complexos.

Detalhes Técnicos: Os 5 Níveis de Complexidade de Ataques Biométricos

A Apura Cyber Intelligence categoriza as investidas para burlar sistemas biométricos em cinco níveis crescentes de sofisticação:

Nível 1: Utilização de fotos digitais em alta resolução, vídeos de alta definição ou máscaras de papel simples.

Nível 2: Confecção de bonecos realistas ou máscaras 3D de látex ou silicone.

Nível 3: Produção de artefatos ultrarrealistas, como cabeças de cera elaboradas.

Nível 4: Alteração de mapas faciais 3D para enganar a autenticação de prova de vida, que verifica se a pessoa é real e não uma representação estática.

Nível 5: Injeção digital de imagens e vídeos diretamente nos dispositivos ou uso de deepfakes altamente convincentes. Esta é a técnica mais avançada, capaz de fazer com que o sistema aceite a fraude como uma atividade orgânica e legítima do usuário.

Quanto maior a complexidade do ataque, mais valioso é o alvo para compensar o investimento em tempo e recursos dos golpistas. Compreender a vulnerabilidade em LLMs e sistemas de IA é crucial para os desenvolvedores que buscam construir barreiras eficazes.

Impacto Econômico e Casos Reais de Fraude com IA

No Brasil, a incidência de fraudes envolvendo deepfakes e identidades digitais sintéticas tem crescido exponencialmente. Um relatório da Deloitte projeta que o prejuízo econômico dessas fraudes, impulsionadas pela IA, pode atingir R$ 4,5 bilhões até o final deste ano, com o uso de deepfakes crescendo cerca de 800% em relação a 2024.

Um caso emblemático na China ilustrou o grave perigo desses golpes: um funcionário estatal foi persuadido a transferir US$ 622 mil (aproximadamente R$ 3,1 milhões) para golpistas após participar de uma videochamada com quem ele acreditava ser seu CEO. A voz e a aparência do executivo foram replicadas de forma impecável pela IA, utilizando vídeos públicos para criar um clone digital. Este cenário ressalta a urgência em desenvolver e implementar permissões de apps e guias de segurança robustos.

A Vibe Coding Brasil e a Luta Contra as Fraudes Digitais

Para a comunidade de desenvolvedores e entusiastas de tecnologia do Vibe Coding Brasil, entender essas ameaças é o primeiro passo para criar soluções mais seguras e resistentes. O desenvolvimento de sistemas de IA éticos e capazes de detectar manipulações é mais importante do que nunca. Afinal, a tecnologia que empodera também deve proteger, garantindo um futuro digital vibrante e seguro para todos.