A Inteligência Artificial (IA) continua a ser uma força motriz de inovação, redefinindo a forma como interagimos com a tecnologia em nossos lares e vidas. Além de aprimorar a conveniência, a IA emerge como uma poderosa ferramenta para a acessibilidade, especialmente no campo da comunicação. No Vibe Coding Brasil, mergulhamos nas oportunidades que a IA oferece para assistentes pessoais e, de forma ainda mais impactante, para a integração da linguagem de sinais.

A Evolução dos Assistentes Pessoais Inteligentes

Os assistentes pessoais, como Alexa, Google Assistant e Siri, tornaram-se onipresentes em muitos lares, facilitando tarefas diárias, controlando dispositivos inteligentes e fornecendo informações instantâneas. A IA é o coração desses sistemas, permitindo-lhes compreender comandos de voz, aprender preferências e até antecipar necessidades dos usuários. A cada atualização, a capacidade de processamento de linguagem natural (PLN) e a inteligência contextual desses assistentes se aprofundam, tornando-os mais do que meros robôs de comando e resposta.

Detalhes Técnicos: Por Trás da Voz e dos Comandos

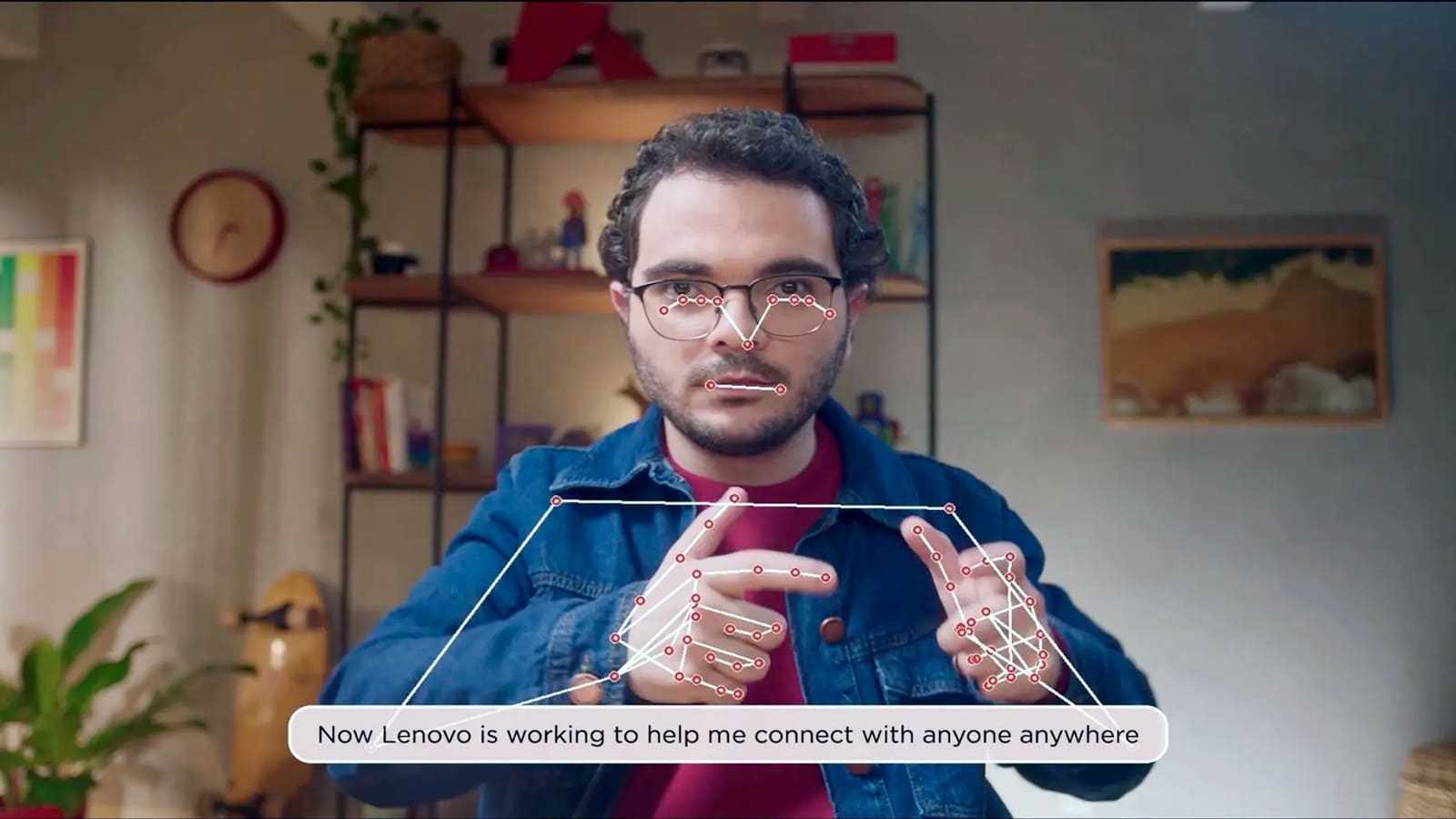

Os assistentes de IA utilizam uma combinação de Processamento de Linguagem Natural (PLN) para entender a fala humana, Machine Learning (ML) para aprender padrões e preferências, e Visão Computacional em dispositivos com câmera para reconhecimento facial e de gestos. Essa sinergia de tecnologias é crucial para uma interação fluida e inteligente.

IA e a Quebra de Barreiras na Linguagem de Sinais

O verdadeiro potencial transformador da IA reside na sua capacidade de criar pontes de comunicação que antes pareciam intransponíveis. Para a comunidade surda, a interação com o mundo digital e com dispositivos assistivos tem sido um desafio. É aqui que a IA, particularmente a visão computacional e o aprendizado profundo, pode fazer uma diferença monumental.

Reconhecimento de Linguagem de Sinais por IA

Pesquisadores e desenvolvedores estão explorando como algoritmos de IA podem ser treinados para reconhecer e interpretar linguagens de sinais, como a Língua Brasileira de Sinais (LIBRAS). Utilizando câmeras e sensores, sistemas de IA podem capturar os movimentos complexos das mãos, expressões faciais e postura corporal, elementos essenciais para a comunicação em sinais. A meta é permitir que uma pessoa utilizando LIBRAS possa interagir com um assistente pessoal, ou que a linguagem de sinais seja traduzida para voz ou texto em tempo real, e vice-versa.

O Desafio da Nuance e Contexto

A linguagem de sinais não é universal e possui dialetos e variações regionais, além de ser rica em nuances contextuais e emocionais. Desenvolver IA capaz de capturar essa complexidade exige vastos conjuntos de dados de treinamento e modelos sofisticados de aprendizado profundo, incluindo redes neurais convolucionais (CNNs) e recorrentes (RNNs) para processar sequências de vídeo.

Impacto Social e Oportunidades para Desenvolvedores

A capacidade de assistentes pessoais entenderem e responderem em linguagem de sinais tem implicações profundas para a inclusão. Imagine um futuro onde pessoas surdas possam controlar sua casa inteligente, fazer perguntas ou se comunicar com o mundo de forma mais autônoma, usando sua língua nativa. Isso não só melhora a qualidade de vida, mas também abre um novo leque de possibilidades para a educação, o trabalho e a participação social.

Para a comunidade de programação e desenvolvimento, essa área representa um campo fértil para inovação. Há uma demanda crescente por:

Desenvolvimento de algoritmos de visão computacional otimizados para reconhecimento de gestos.

Criação de APIs e SDKs que permitam a integração de reconhecimento de sinais em diferentes plataformas e dispositivos.

Ferramentas de coleta e anotação de dados para treinamento de modelos de IA em linguagens de sinais específicas.

Sistemas de tradução bidirecional (sinal para texto/voz e vice-versa) em tempo real.

Um Futuro Mais Conectado e Acessível

A convergência da IA com a acessibilidade está apenas começando. A oportunidade de utilizar a Inteligência Artificial para inovar em assistentes pessoais e, mais crucialmente, para empoderar a comunicação através da linguagem de sinais, é imensa. No Vibe Coding Brasil, celebramos esses avanços e encorajamos nossa comunidade de desenvolvedores a explorar e contribuir para um futuro onde a tecnologia realmente serve a todos. A vibração da inovação em IA promete um mundo mais conectado e inclusivo para cada um de nós!

Se você se interessa por este tópico, confira o artigo original da Microsoft:

The opportunity at home – can AI drive innovation in personal assistant devices and sign language?