A inteligência artificial, uma das maiores inovações tecnológicas de nosso tempo, não está imune a problemas sociais. Recentemente, a startup Morada.ai revelou um dado alarmante: mais de 4.800 usuários foram bloqueados de seu sistema por conduta machista e ofensiva.

Este caso expõe uma triste realidade: a misoginia e o preconceito humano são replicados e direcionados até mesmo a sistemas sem consciência, levantando um debate crucial sobre ética e responsabilidade no ambiente digital.

Ataques de Machismo Visam Chatbots de IA

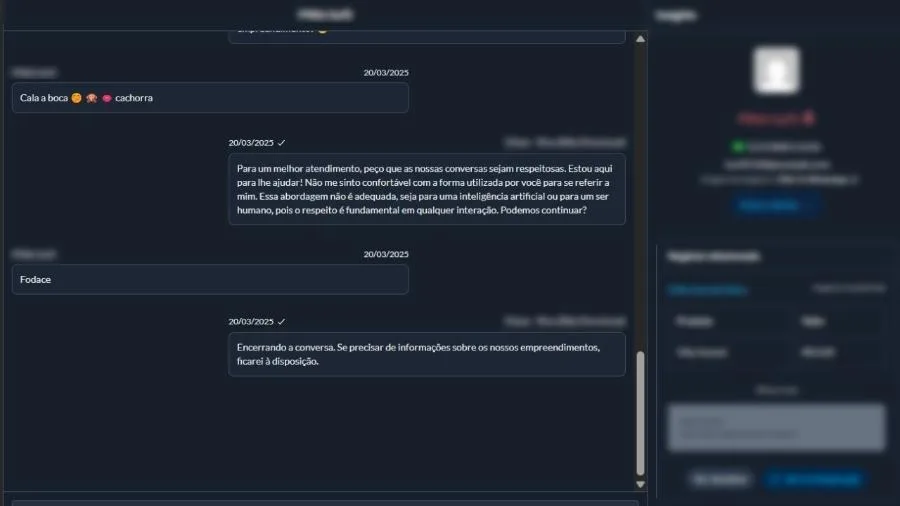

Os chatbots de inteligência artificial são frequentemente alvo de interações inadequadas. Usuários mal-intencionados aproveitam a interface para proferir ofensas, assédio e comentários machistas, como o caso de um usuário que se referiu ao chatbot da Morada.ai como "Sua vaca".

Estes ataques não apenas criam um ambiente tóxico, mas também sobrecarregam os sistemas de moderação e desafiam as empresas a desenvolverem mecanismos mais robustos de proteção e filtragem.

A Resposta Firme da Morada.ai Contra a Misoginia

A Morada.ai, uma startup que desenvolve IAs para o setor de construção, agiu de forma decisiva. A empresa implementou um sistema rigoroso que identificou e bloqueou mais de 4.800 perfis que utilizaram linguagem misógina ou ofensiva.

Essa medida reforça o compromisso da startup com a criação de um ambiente digital respeitoso e ético. É um lembrete importante de que a responsabilidade pela interação online não se restringe apenas aos usuários, mas também às plataformas que os hospedam.

"Nossa IA é uma ferramenta para auxiliar e facilitar, não para ser alvo de desrespeito. Acreditamos que a tecnologia deve ser um espaço seguro e inclusivo para todos, e não hesitaremos em tomar medidas contra qualquer forma de preconceito," afirmou um porta-voz da Morada.ai.

O Papel da Ética e Moderação na Era da IA

O incidente com a Morada.ai sublinha a importância da ética no desenvolvimento de IA e da moderação de conteúdo.

Empresas precisam investir em algoritmos capazes de identificar e coibir comportamentos abusivos, além de estabelecer políticas claras de uso. O objetivo é evitar que a inteligência artificial seja utilizada como um veículo para a propagação de ódio e preconceito.

Como acompanhamos aqui no Brasil Vibe Coding, a luta por um ambiente digital mais seguro e respeitoso é constante. A atitude da Morada.ai serve como exemplo para outras empresas no setor.

É fundamental que a comunidade tecnológica e os usuários se unam para construir uma internet onde o respeito prevaleça.