A ByteDance, empresa por trás do TikTok, liberou a versão pública do aguardado Seedance 2.0 nesta segunda-feira, 15 de abril. Após meses de acesso restrito a parceiros comerciais e alguns adiamentos, a ferramenta que promete transformar a criação de conteúdo em vídeo está agora disponível para testadores em todo o mundo. A novidade, que movimentou o mercado de tecnologia, confirma o potencial da inteligência artificial generativa aplicada ao audiovisual.

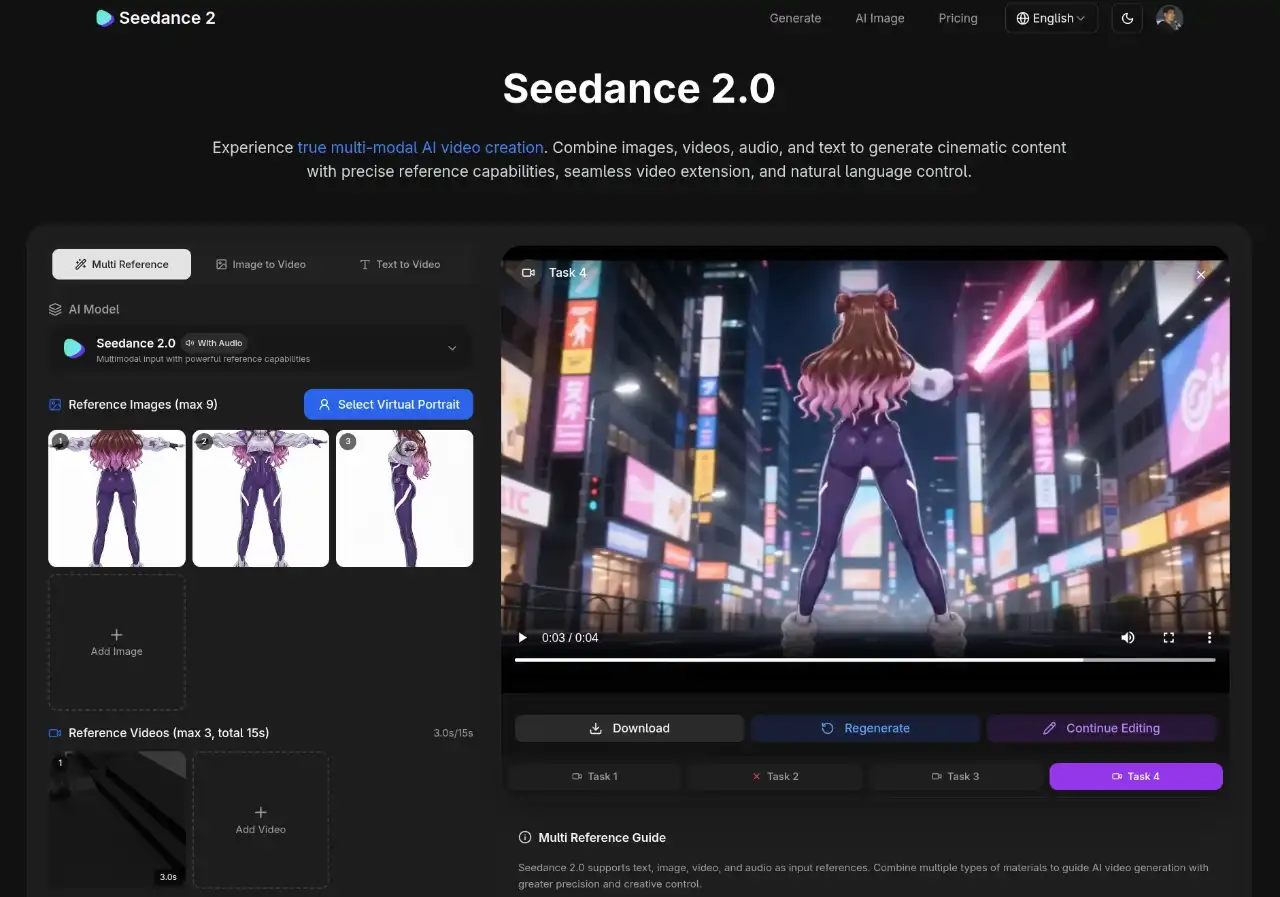

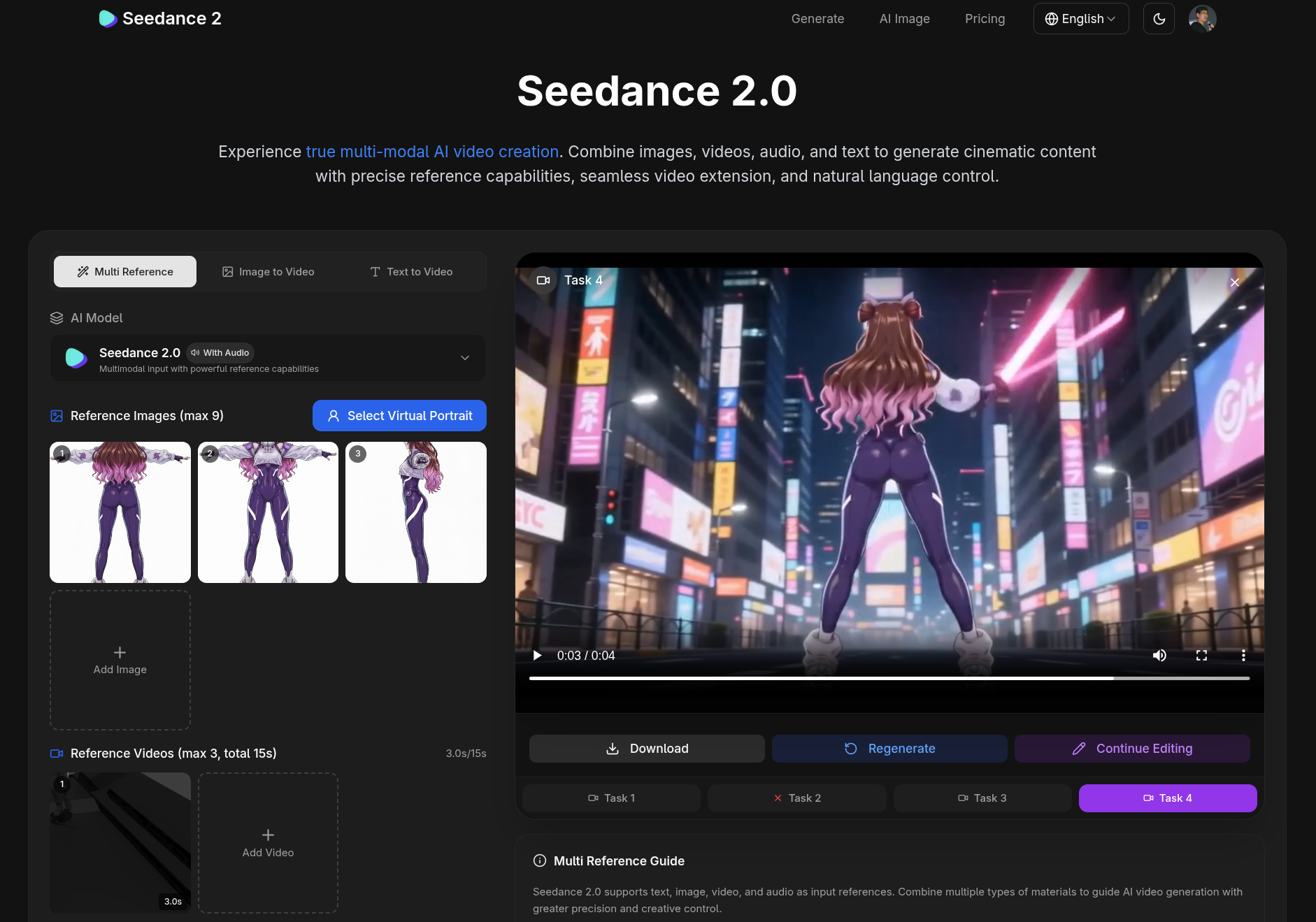

A proposta do Seedance 2.0 é ambiciosa. É um modelo multimodal avançado capaz de gerar vídeos a partir de diversas entradas simultâneas. Ele aceita texto, até 9 imagens de referência, 3 clipes de vídeo de apoio e até 3 trilhas de áudio em uma única interação. Isso oferece uma flexibilidade inédita na personalização e na criação de cenas complexas.

A saída do modelo pode ter até 15 segundos de duração, com áudio sincronizado nativamente que inclui diálogos, efeitos sonoros e música ambiente. Além disso, o Seedance 2.0 suporta a extensão de vídeos existentes, permite a edição pontual de personagens e objetos, e possibilita o planejamento de câmera dirigido por prompts textuais. A ByteDance posiciona a ferramenta para uma vasta gama de aplicações profissionais, incluindo publicidade, vídeos explicativos, produção cinematográfica, e-commerce e até mesmo gaming. É uma solução que visa elevar o padrão da produção de conteúdo, levando-o do estágio amador a um nível mais profissional.

Para quem deseja ver o modelo em ação e entender seu funcionamento antes de se aprofundar nos detalhes, recomendamos a análise detalhada feita por Stefan, do canal Stefan 3D AI Lab. O especialista já havia sido mencionado em um post anterior sobre modelagem 3D com IA, e seu vídeo oferece uma excelente visão geral das capacidades do Seedance 2.0.

A interface principal da ferramenta está no “Photo Studio” da Dreamina. Nela, os usuários podem selecionar o modo de geração desejado e "empilhar" suas referências, construindo a cena de forma intuitiva. Os testes iniciais do sistema se concentraram no modo de multi-referência padrão, que já demonstra grande potencial para diversos projetos.

Teste de Lip-Sync com Áudio Personalizado

Um dos primeiros testes práticos com o Seedance 2.0 envolveu a capacidade de sincronização labial (lip-sync). Um trecho do bumper de abertura de um podcast, gerado anteriormente com IA através da pipeline ElevenLabs v3, foi utilizado como áudio base. A imagem de referência escolhida foi um avatar em estilo anime, que ganhou vida com o áudio personalizado.

Avatar anime sincronizando boca com áudio do bumper do M.Akita Chronicles, demonstrando o poder do Seedance 2.0.

Os resultados são notavelmente bons. A geração ocorreu a partir de uma única imagem fixa, e o lip-sync acompanhou a fala de forma razoavelmente precisa. A expressão do avatar ganhou alguma vitalidade, e os gestos das mãos surgiram em momentos apropriados. No entanto, é importante ressaltar que, por enquanto, esse tipo de resultado é ideal para clipes curtos ou conteúdo para plataformas como YouTube e Instagram. Para a produção de aberturas de vídeos profissionais, ainda há um caminho a percorrer, mas o potencial já está claro.

A Força da Referência em Vídeo para Produções Sérias

A verdadeira inovação do Seedance 2.0, e o que o diferencia para trabalhos mais sérios, reside na sua capacidade de utilizar vídeos como referência. A descrição puramente textual, por mais detalhada que seja, raramente proporciona o nível de precisão necessário para produções cinematográficas ou publicitárias. A variação entre as gerações baseadas apenas em texto é considerável, tornando o processo imprevisível para diretores e produtores.

Muitos entusiastas da IA ficam impressionados com clipes gerados aleatoriamente que parecem esteticamente agradáveis, compartilhando-os em redes sociais como X e Instagram. Contudo, essa qualidade muitas vezes é fruto de sorte, e não de controle criativo. Em contextos profissionais, onde a transição entre cenas precisa ser coesa e planejada, a ausência de controle é um problema.

A ferramenta que permite ao criador dizer ao modelo: "faça exatamente este movimento, com exatamente esta câmera" é um diferencial. É nesse ponto que a referência em vídeo transforma completamente o fluxo de trabalho. Ela possibilita economizar horas de modelagem 3D, rigging, animação e renderização, processos que tradicionalmente custam muito em estúdios de produção. Essa funcionalidade abre portas para a produção de conteúdo de alta qualidade com um custo e tempo significativamente reduzidos, um grande avanço para a indústria.

Impacto no Mercado e Futuro da Criação de Conteúdo

O lançamento do Seedance 2.0 reforça a crescente importância da Inteligência Artificial Generativa no setor criativo. A capacidade de traduzir ideias complexas em vídeos realistas com um nível de detalhe impressionante democratiza o acesso a ferramentas de produção antes restritas a grandes estúdios. Pequenos criadores de conteúdo, agências de publicidade e até mesmo desenvolvedores de jogos podem agora aproveitar o poder da IA para criar visuais de alta qualidade de forma mais eficiente, o que é um dos temas mais relevantes atualmente.

A ferramenta tem o potencial de transformar indústrias inteiras. No cinema, por exemplo, pré-visualizações (pré-produção de cenas) podem ser mais rápidas e detalhadas. Na publicidade, a criação de anúncios personalizados e adaptáveis se torna mais viável. Para desenvolvedores de games, protótipos de cinemática podem ser gerados com agilidade. Isso representa uma verdadeira automação de parte do processo criativo, liberando os artistas para focarem na visão e na direção, em vez de tarefas repetitivas e demoradas.

A facilidade de uso da interface do “Photo Studio” da Dreamina, aliada à robustez do modelo multimodal, sugere que a curva de aprendizado para profissionais pode ser relativamente rápida. Essa acessibilidade é fundamental para a adoção em massa da tecnologia. Empresas de tecnologia como a ByteDance estão investindo pesado em modelos generativos, e a competição entre elas promete acelerar ainda mais o desenvolvimento dessas ferramentas, tornando-as cada vez mais sofisticadas e eficientes.

Considerações Finais e Próximos Passos

O Seedance 2.0 da ByteDance é um marco significativo no desenvolvimento da IA para criação de vídeo. Sua capacidade multimodal, que integra texto, imagens, vídeos e áudio como referências, eleva o patamar do que é possível com a inteligência artificial generativa. Embora ainda existam desafios, especialmente em relação ao nível de controle necessário para produções de altíssimo orçamento, o potencial para a automação e a democratização da produção de conteúdo é inegável, e o modelo atual já é capaz de criar conteúdo surpreendente.

À medida que a tecnologia avança, podemos esperar que as capacidades de refinamento e controle se tornem ainda mais precisas, tornando ferramentas como o Seedance 2.0 indispensáveis para qualquer profissional criativo. O futuro da produção de vídeo está se tornando cada vez mais interligado com a inteligência artificial, e inovações como esta nos mostram que estamos apenas no começo de uma era de possibilidades ilimitadas.