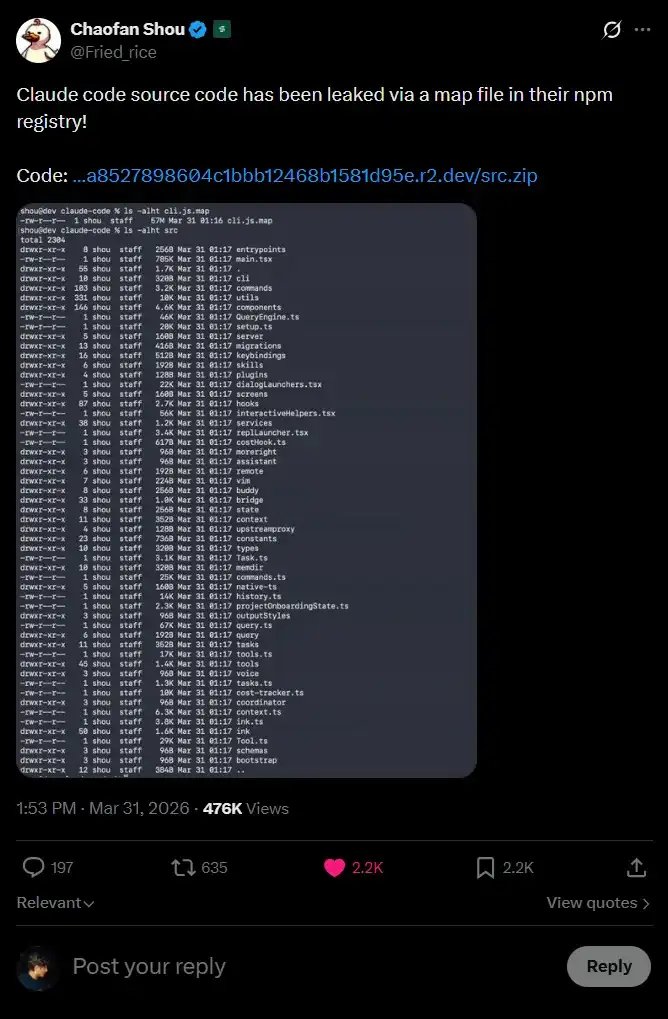

Na manhã de 31 de março de 2026, uma revelação surpreendeu a comunidade de tecnologia e inteligência artificial. O pesquisador de segurança Chaofan Shou tornou público o código-fonte completo do Claude Code, a interface de linha de comando (CLI) oficial da Anthropic para programação assistida por IA. Mais de 512 mil linhas de TypeScript e 1.900 arquivos foram expostos.

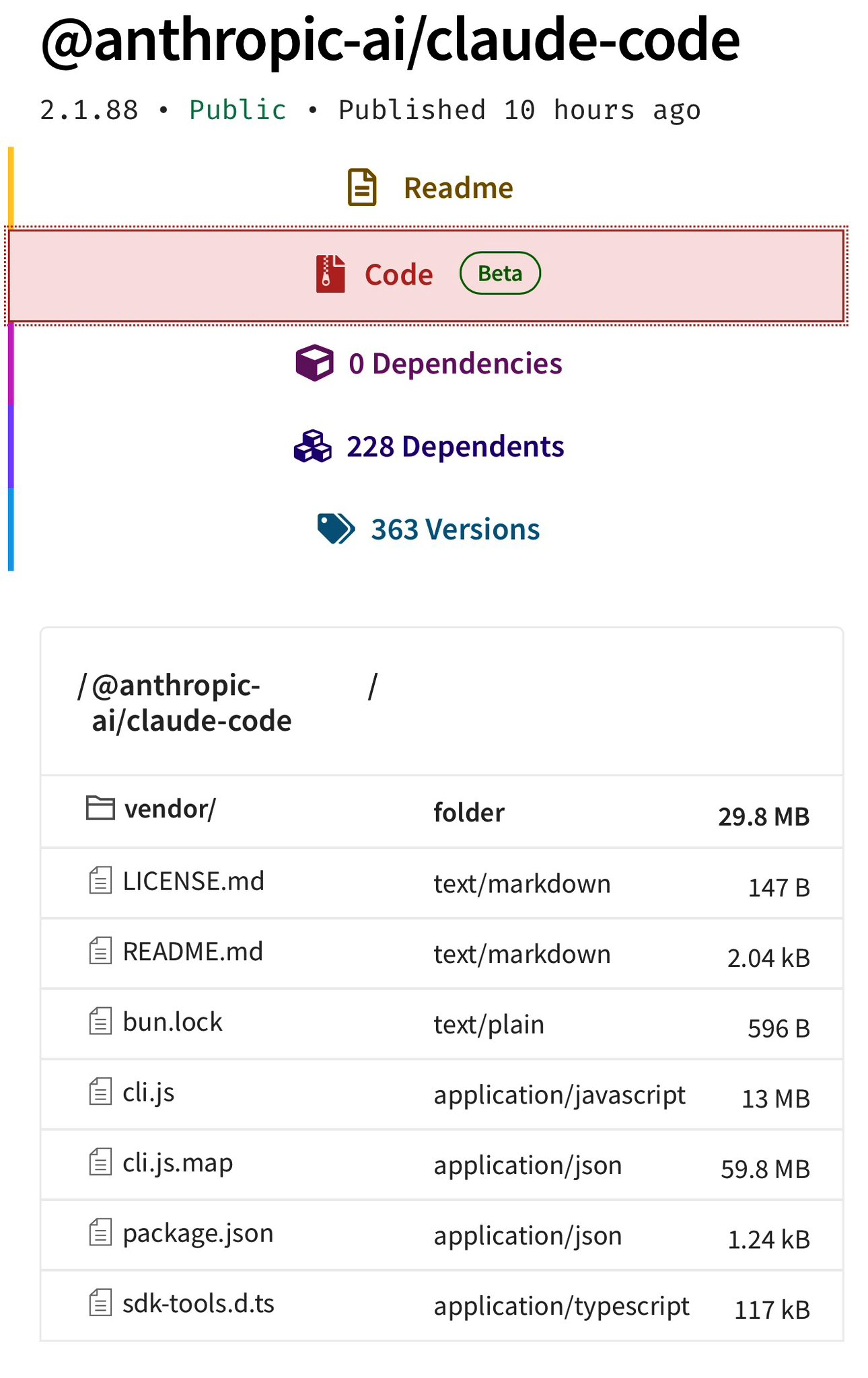

Isso aconteceu por meio de um arquivo de source map de 59.8MB, incluído acidentalmente na versão 2.1.88 do pacote @anthropic-ai/claude-code no registro público do npm. Em poucas horas, o código já estava circulando pelo GitHub e sendo analisado por milhares de desenvolvedores.

A Anthropic emitiu uma nota rapidamente, afirmando que se tratava de um “erro humano no empacotamento de release, não uma brecha de segurança”. Embora tecnicamente correta, essa declaração não muda o fato de que o resultado foi o mesmo: uma exposição massiva de informações internas.

O que causou o vazamento do Claude Code

No início, a comunidade especulou que o incidente estaria ligado a um bug conhecido no Bun, o runtime JavaScript adquirido pela Anthropic no final de 2024. O Bun, por padrão, gera source maps durante a compilação, e esses arquivos contêm o código-fonte original completo, incluindo comentários e constantes internas.

No entanto, Jarred Sumner, criador do Bun, negou essa teoria rapidamente. Ele explicou que o bug do Bun afeta apenas o servidor de desenvolvimento de frontend, e não estava relacionado ao processo de build que gerou o pacote npm do Claude Code. “Isso não tem nada a ver com o código do Claude. Isso é com o servidor de desenvolvimento de frontend do Bun. Claude Code não é um aplicativo de frontend. É uma TUI. Não usa Bun.serve() para compilar um executável de arquivo único”, afirmou Sumner.

A realidade, segundo análises e reportagens como a do The Register, foi bem mais simples e, ironicamente, um erro humano. Alguém na Anthropic aparentemente esqueceu de adicionar *.map ao arquivo .npmignore ou falhou em configurar o bundler para evitar a geração de source maps em builds de produção. O mais preocupante é que o source map não apenas apontava para os arquivos originais, mas também fazia referência a um arquivo ZIP hospedado em um bucket Cloudflare R2 da própria Anthropic. O npm, sem restrições, serviu o conteúdo a quem executasse npm pack, expondo a propriedade intelectual.

Funcionalidades ocultas e o modo secreto da IA

A análise do código-fonte vazado revelou a existência de 44 feature flags, indicando funcionalidades desenvolvidas e testadas, mas ainda não lançadas ao público. Essas não são apenas ideias, mas sim código real, oculto por trás de sinalizadores que são desativados em versões externas da ferramenta.

KAIROS: O Claude que atua sem interrupções

Uma das descobertas mais fascinantes é o modo KAIROS, localizado no diretório assistant/. Trata-se de um assistente persistente, com capacidade de observação e atuação proativa. Ao contrário dos modelos tradicionais que esperam por um comando explícito, o KAIROS monitora o ambiente, registra informações em logs diários e decide quando agir.

Ele recebe prompts <tick> em intervalos regulares para avaliar se deve intervir ou permanecer em modo de espera. Um detalhe crucial é seu orçamento de 15 segundos: qualquer ação proativa que possa bloquear o workflow do usuário por mais de quinze segundos é adiada, mostrando uma preocupação com a interrupção mínima.

O KAIROS possui ferramentas exclusivas como o SendUserSlackMessage, que permite ao assistente enviar mensagens ativamente, e o ScheduleInternalMeeting, que sugere agendamento de reuniões. Isso aponta para um futuro onde a IA não apenas responde, mas inicia interações e organiza tarefas. A complexidade do KAIROS demonstra o grau de automação que a Anthropic está buscando.

Modo Incógnito: Prevenindo vazamentos internos

A ironia do vazamento se aprofunda ao descobrirmos um sistema inteiro chamado “Undercover Mode” (Modo Incógnito) dentro do código. Esse sistema foi projetado especificamente para impedir que informações internas da Anthropic vazassem em commits e pull requests. É um subsistema feito para evitar que a IA revele codinomes internos ou dados sensíveis.

Contudo, o próprio source map que vazou expôs tudo o que o Undercover Mode deveria proteger. Isso ressalta a complexidade de gerenciar a segurança em sistemas de IA, especialmente quando se lida com a distribuição de software. O episódio serve como um forte lembrete de que a segurança de software vai além do código em si, abrangendo todo o ciclo de vida de desenvolvimento e empacotamento.

Automação de tarefas e integrações futuras

O código também indica um futuro de maior automação e integração para o Claude Code. As feature flags revelam planos para que a IA possa automatizar testes de código com mais profundidade, integrar-se nativamente com ambientes de desenvolvimento integrado (IDEs) e até mesmo gerenciar pequenas equipes de desenvolvimento. A capacidade de um assistente IA em agendar reuniões ou enviar mensagens proativas é um passo significativo em direção a uma IA mais autônoma e colaborativa.

Essas funcionalidades, se implementadas, poderiam transformar a maneira como desenvolvedores trabalham, direcionando o foco de tarefas repetitivas para a criação e resolução de problemas mais complexos. A Anthropic parece estar construindo um ecossistema onde a IA não é apenas uma ferramenta, mas um membro ativo da equipe de desenvolvimento, participando ativamente do ciclo de vida do software.

Impacto no Brasil e reflexões para a comunidade Dev

O vazamento do código-fonte do Claude Code, embora um incidente de segurança para a Anthropic, pode ser uma fonte rica de aprendizado para desenvolvedores e empresas ao redor do mundo, incluindo o Brasil. A exposição dessas 512 mil linhas de TypeScript oferece uma visão sem precedentes sobre como uma das empresas líderes em IA constrói suas ferramentas de programação.

Para a comunidade de desenvolvedores e entusiastas de programação no Brasil, isso significa a oportunidade de estudar implementações avançadas de IA. Entender os detalhes do KAIROS ou do Undercover Mode pode inspirar novas abordagens no desenvolvimento de ferramentas locais, especialmente aquelas focadas em automação e eficiência. Empresas brasileiras de tecnologia podem analisar as arquiteturas para aprimorar seus próprios sistemas.

O incidente também serve como um alerta para a importância da segurança no processo de deploy de software. Erros simples na configuração de um bundler ou de um arquivo .npmignore podem ter consequências significativas, mesmo para gigantes da tecnologia. Essa é uma lição valiosa para startups e grandes corporações brasileiras que desenvolvem e distribuem software.

Conclusão: Segurança, inovação e o futuro da IA na programação

O vazamento do Claude Code da Anthropic é um evento marcante, que expõe tanto a fragilidade da segurança em processos de build quanto a ambição por trás das inovações em Inteligência Artificial. Revelações como o modo KAIROS e o sistema Undercover Mode mostram o potencial de transformação das IAs no desenvolvimento de software, com funções que vão além da simples assistência.

Esse episódio sublinha a necessidade de um equilíbrio entre a velocidade da inovação e a robustez dos processos de segurança. Embora acidental, o acesso a esse volume de código-fonte oferece um vislumbre sobre o futuro da programação e da automação impulsionada por IA.