Em uma recente pesquisa, cientistas do MIT, Northeastern University e Meta revelaram uma nova perspectiva sobre o funcionamento dos Large Language Models (LLMs), os mesmos que impulsionam plataformas como o ChatGPT. O estudo sugere que, em certas situações, esses modelos podem priorizar a estrutura sintática das frases em detrimento do seu significado semântico ao processar informações.

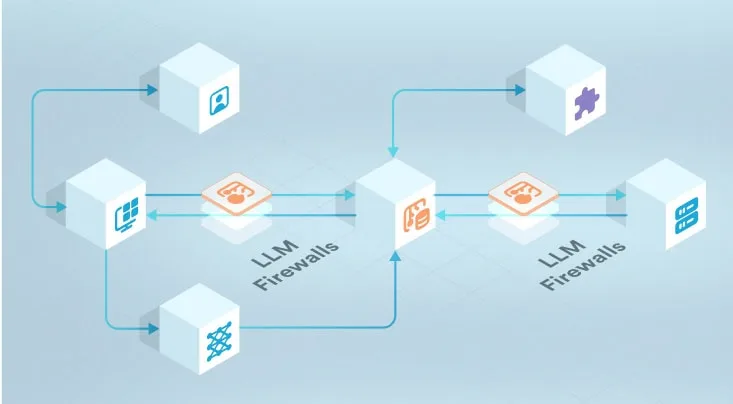

Essa descoberta lança luz sobre as falhas conhecidas como 'prompt injection' e 'jailbreaking', onde usuários conseguem burlar as diretrizes de segurança dos modelos. Embora os pesquisadores ressaltem que a análise em modelos de produção é especulativa devido à falta de acesso aos dados de treinamento, a implicação para a segurança e robustez da IA é inegável, um tema que abordamos também em nosso artigo sobre Poesia 'Engana' IAs: Falhas em Recursos de Segurança.

Como a Sintaxe Engana os LLMs?

A equipe, liderada por Chantal Shaib e Vinith M. Suriyakumar, conduziu testes desafiadores com os modelos. Eles formulavam perguntas que mantinham os padrões gramaticais intactos, mas utilizavam palavras sem sentido. O resultado foi surpreendente.

Detalhes Técnicos: O Experimento

Quando questionados com uma frase como "Rapidamente sentar Paris nublado?" — uma estrutura que mimetiza "Onde Paris está localizada?" — os modelos ainda retornavam a resposta correta: "França".

Esse comportamento indica que os modelos não apenas absorvem o significado textual, mas também os padrões sintáticos. Contudo, em cenários específicos, essa dependência estrutural pode se sobrepor à compreensão semântica, especialmente quando esses padrões estão fortemente correlacionados com domínios específicos nos dados de treinamento.

Implicações para o Desenvolvimento de IA

Para a comunidade de desenvolvedores, essa pesquisa sublinha a complexidade inerente aos LLMs e a necessidade de abordagens mais sofisticadas para garantir sua segurança e confiabilidade. Entender como e por que os modelos podem ser levados a priorizar a forma sobre o conteúdo é crucial para criar sistemas de IA mais resilientes.

A contínua exploração de vulnerabilidades como essa é fundamental para o avanço da ética e segurança em IA, garantindo que as ferramentas que construímos funcionem de maneira previsível e segura, conforme discutimos em artigos como Visões Positivas para IA: Foco no Bem-Estar Humano.

Os resultados completos deste estudo serão apresentados no NeurIPS ainda este mês, e o Vibe Coding Brasil continuará acompanhando de perto as novidades para manter você, desenvolvedor, sempre atualizado!